- Agradecimiento por invitación durante Semana de la Salud Pública

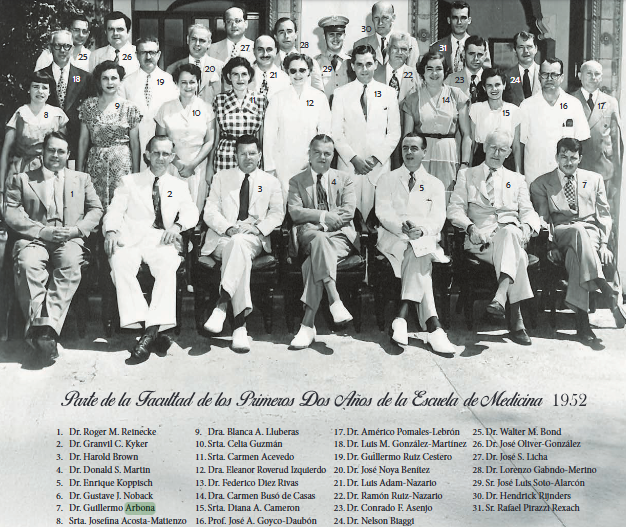

- Reconocimientos: clase 1990, mentores, colegas, fundadores del RCM UPR

Introducción: cuando la prevención funciona, nada ocurre

La epidemiología es una disciplina paradójica: cuando funciona, no pasa nada.

No hay brote, no hay epidemia, no hay titulares. Pero detrás de ese “nada” hay décadas de ciencia, juicio y acción.

En esta breve charla mostraremos cómo la epidemiología ha cambiado, qué permanece, y por qué, en plena era de inteligencia artificial, el razonamiento epidemiológico clásico sigue siendo indispensable.

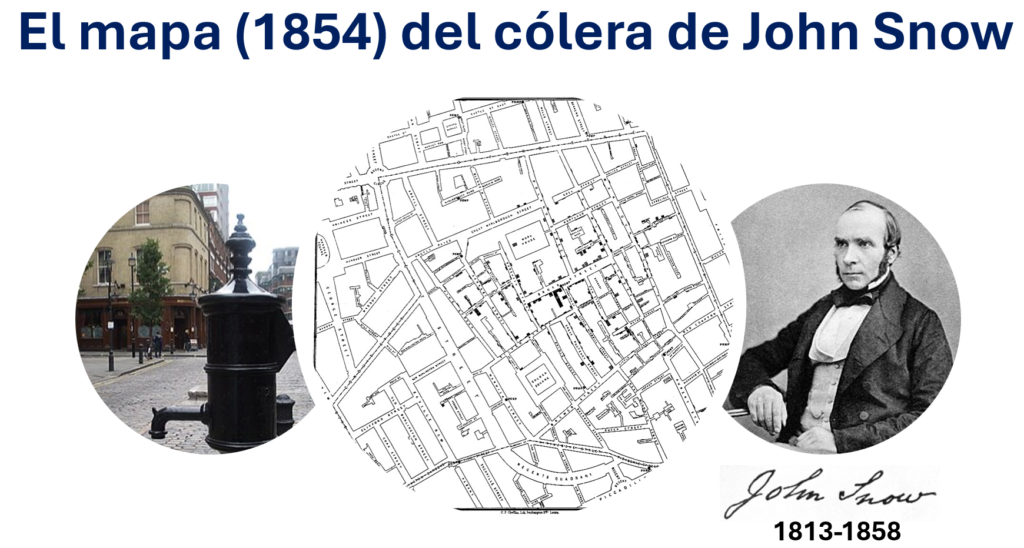

John Snow: el origen del método

John Snow no tenía datos masivos, ni algoritmos, ni computadoras. Tenía algo más poderoso: el método fundamental de la epidemiología:

- observar,

- comparar,

- razonar,

- y tomar acción preventiva.

Snow no solo identificó la Fuente del cólera; convenció a las autoridades de actuar.

Contribución del pediatra, epidemiologo e historiador puertorrique¤o Dr. José G. Rigau-Pérez

Observar, comparar, razonar y tomar acción preventiva representan el corazón de la epidemiología: la inferencia causal al servicio del bien público, al igual que lo hicieron:

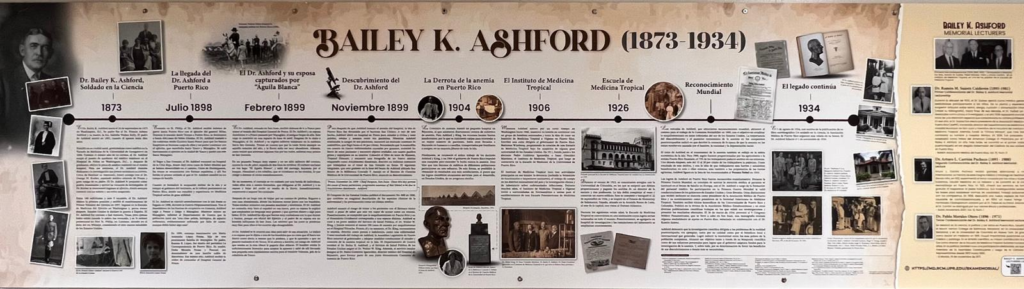

- Dr. Ashford respecto a la uncinariasis, fundiendo la observación clínica con el laboratorio.

- Carlos Chardon, naturalista, agrónomo, administrador público, quien identificó junto a Rafael Veve el insecto transmisor del mosaico de la caña, salvando la industria azucarera.

- Marta Robert de Roméu, médica, feminista, pionera de la salud materno-infantil quiend dirigió el Negociado de Higiene Maternal e Infantil, logrando:

↓ 17% mortalidad materna, ↓ >80% tétanos neonatal, ↓ 28% oftalmia neonatal - Eduardo Garrido Morales, médico y primer epidemiólogo moderno de Puerto Rico. Doctorado en Salud Pública en Johns Hopkins, discípulo de Wade Hampton Frost. Fundó la División de Epidemiología del Departamento de Sanidad.

- Ramón M. Suárez, clínico, investigador, pionero en cardiología y hematología. Investigó el esprú tropical por 20 años, identificando tratamientos eficaces (ácido fólico, B12).Investigó epidemias de tifoidea, polio, sarampión, difteria y tuberculosis.

Estos son cuatro ejemplos entre varios otros prominentes, como el Dr. Isaac Gonzalez Martinez en sus estudios sobre bilarzia, que el Dr. Rigau integra a la denominada Generación de los 30 de esa epoca, tendiendo un puente entre las dos culturas: la literaria y la cientifica.

Cuatro épocas de la inteligencia epidemiológica

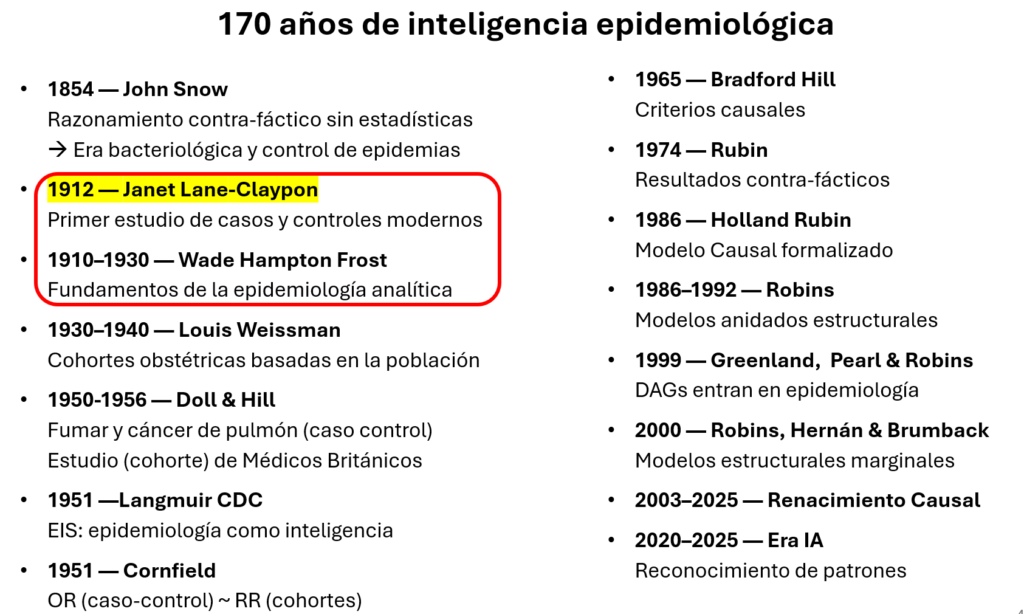

Fase preformal — antes de 1900: Graunt, Farr, Snow

Surge pensamiento poblacional; Snow: razonamiento epidemiológico.

Fase temprana — 1900–1930s: Pasteur, Koch, Lane-Claypon, Frost

Bacteriología; Janet Lane-Claypon introduce casos y controles; Frost formaliza lógica de cohortes.

Fase Clásica — 1940–1970: Doll & Hill, Cornfield, Bradford Hill, Langmuir

CDC-EIS; diseños maduran; equivalencia OR~RR; criterios causales articulados.

Fase moderna — años 70–presente: Rubin, Holland, Robins, Greenland, Pearl

Inferencia causal formal y contra-fáctica, DAG (gráficos acíclicos dirigidos).

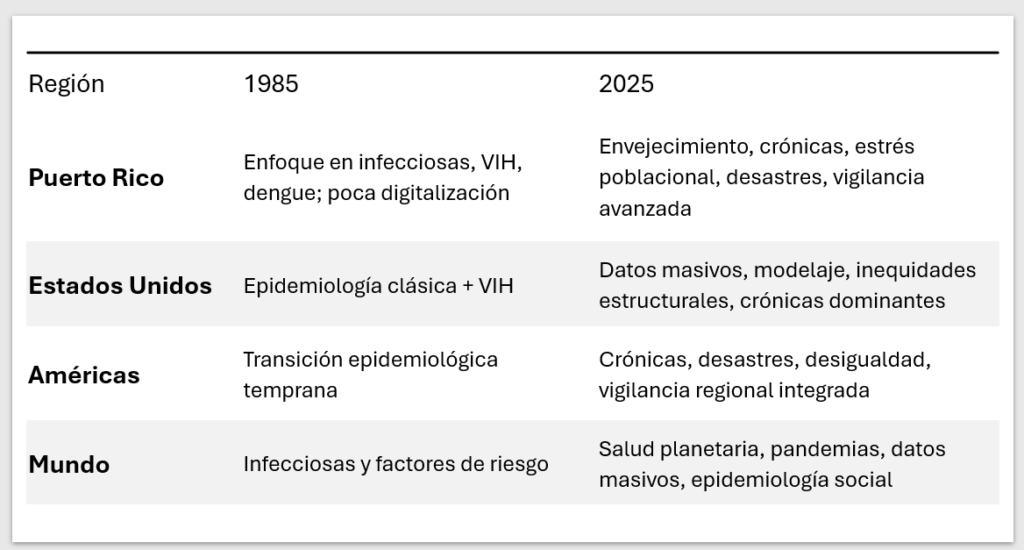

1985–2025: cuatro décadas que cambiaron la disciplina

En estos 40 años, la epidemiología vivió tres revoluciones:

- La revolución de los datos: De bases pequeñas a sistemas masivos, automatizados, en tiempo real.

- La revolución del analista: Aparece el científico de datos: produce dashboards instantáneos, curvas, mapas, modelos. Pero esos datos, sin IE, pueden inducir a error.

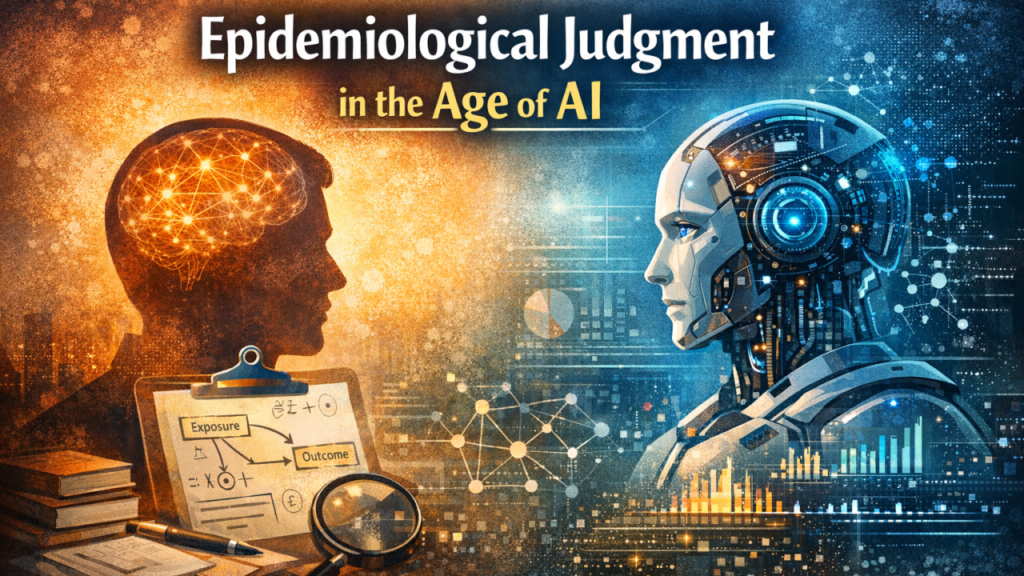

- La revolución de la IA: Hoy tenemos algoritmos que detectan patrones que ningún humano podría ver. Pero —y este es el punto central— los datos no piensan. La IA reconoce correlaciones; la IE reconoce causalidad.

En el cerebro, un axón transmite impulsos que se modulan en miles de sinapsis vivas. En una red neuronal artificial, esa misma idea se representa como un vector de ponderaciones estadísticas que orienta cómo fluye la información.

Ese vector no solo calcula: transmite “energía informacional”, en el sentido de Wheeler (“It from Bit”), porque determina qué posibilidades se actualizan en la siguiente capa.

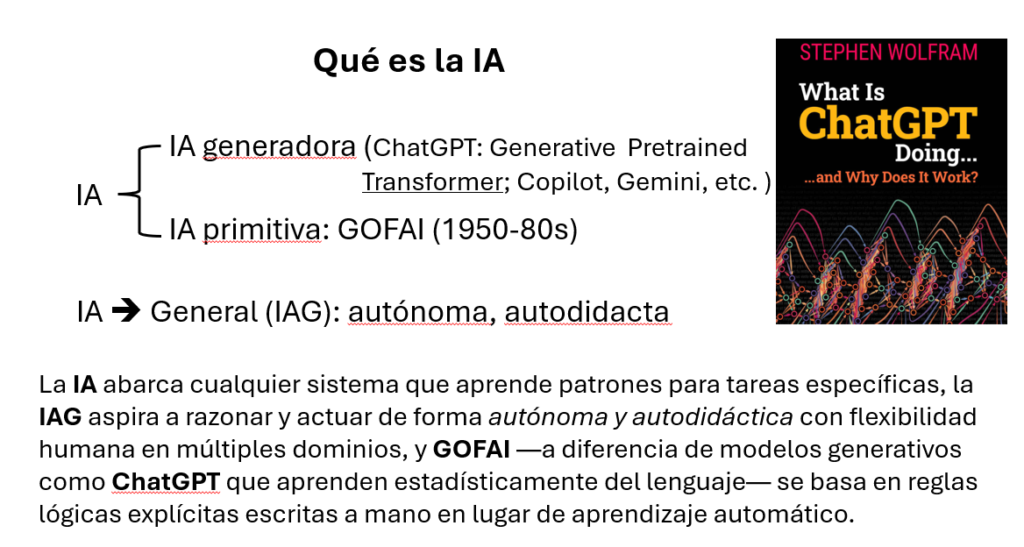

La inteligencia artificial generadora —como ChatGPT y otros modelos de lenguaje— es un tipo de sistema informático diseñado para producir contenido nuevo: textos, imágenes, código, música o ideas, a partir de patrones aprendidos en grandes cantidades de información.

La Inteligencia Epidemiológica ante la IA

La IA puede procesar millones de registros en segundos. Pero no puede responder la pregunta esencial: ¿Esto causa aquello? Porque la causalidad no está en los datos; está en:

- la teoría,

- la biología,

- el contexto,

- la ética,

- y el juicio humano.

La IA puede decirnos qué está pasando. La IE nos dice por qué y qué debemos hacer.

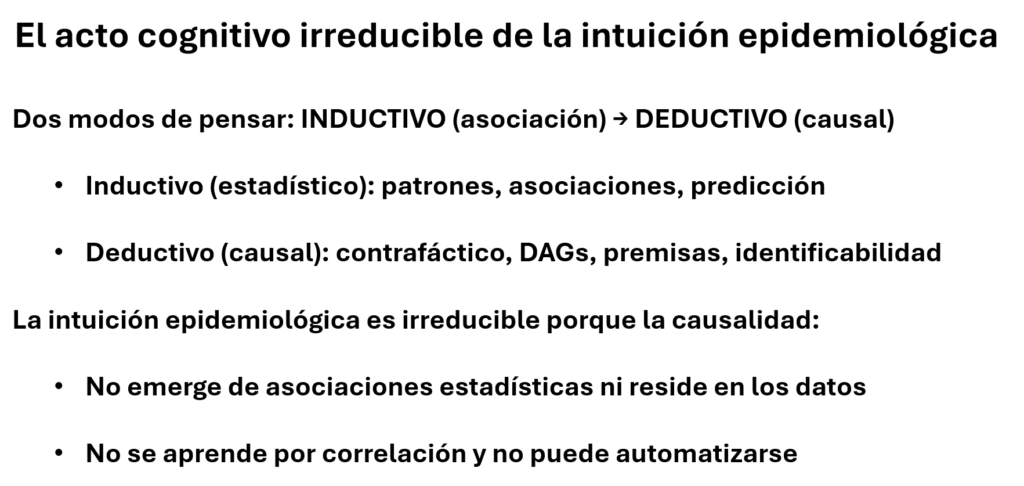

La epidemiología siempre ha combinado dos modos de pensar: el inductivo, que detecta patrones en los datos, y el deductivo, que articula supuestos, causalidad y contrafactuales. Pero el corazón del juicio epidemiológico no está en ninguno de los dos, sino en la capacidad humana de saber cuándo cambiar de uno al otro. Ese cambio de modo —ese acto cognitivo irreducible— no está en los datos ni en los algoritmos. Y por eso, aunque la IA acelera el análisis, no puede reemplazar el juicio.

La IA no solo amplifica el modo inductivo; lo acelera a velocidad de máquina.

Pero sigue sin poder hacer el acto cognitivo irreducible del juicio epidemiológico.

Dos ejemplos puertorriqueños: IE en acción

A. La regionalización de Arbona

Arbona entendió que la fragmentación del sistema de salud era una causa estructural de enfermedad y muerte. La regionalización fue una intervención epidemiológica: definió poblaciones, niveles de atención, rutas de referidos y distribución equitativa de recursos. No fue administración: fue causalidad aplicada.

B. La reapertura escolar durante COVID‑19

Los algoritmos recomendaban cerrar escuelas por transmisión pediátrica. La IE distinguió transmisión de patogenicidad. Los niños transmitían más, pero enfermaban menos; los docentes ya tenían vacuna; el cierre escolar causaba daño educativo y social masivo. La decisión de reabrir no fue algorítmica: fue juicio epidemiológico, integrando biología, ética y consecuencias.

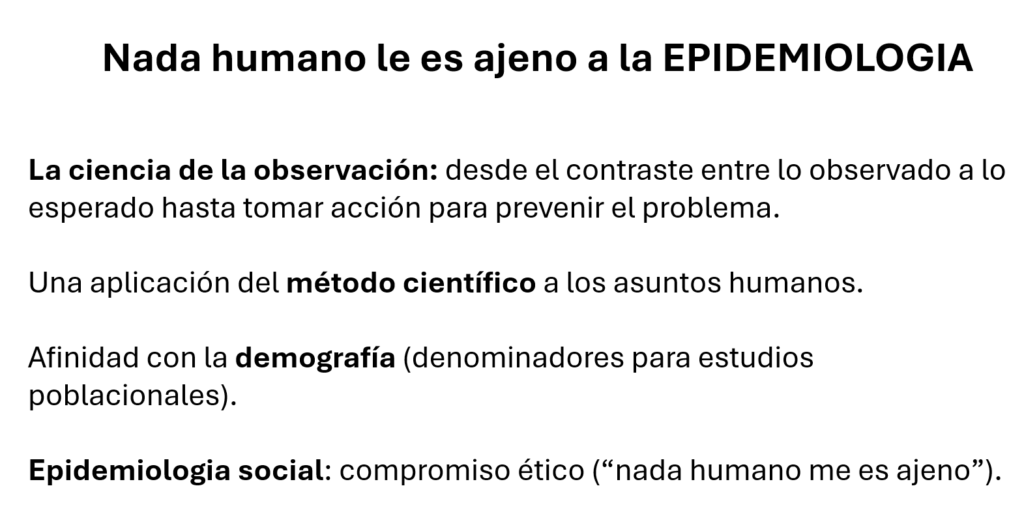

La frase “Nada humano me es ajeno” (Humani nihil a me alienum puto) pertenece originalmente al comediógrafo romano Terencio (siglo II a.C.). Sin embargo, se asocia con Albert Camus, ya que toda su obra —especialmente La Peste— es una encarnación de ese sentimiento: la solidaridad ante el sufrimiento colectivo y la negativa a mirar hacia otro lado cuando una comunidad es golpeada.

Si la epidemiología clásica se pregunta qué agente causa la enfermedad, la epidemiología social se pregunta quién enferma y por qué su lugar en la estructura social determina su destino biológico.

Advertencia sobre la IA general autónoma

Hasta aquí hemos hablado de IA como herramienta. Pero se nos advierte que estamos entrando en una fase distinta: la IA deja de ser un instrumento y se convierte en un agente. Un agente que:

- toma decisiones,

- optimiza objetivos propios,

- manipula información,

- influye en poblaciones,

- y actúa más rápido de lo que los humanos pueden supervisar.

Una IA autónoma puede afectar directamente los pilares de la salud pública:

- información (desinformación salubrista a gran escala),

- confianza (erosión institucional),

- coordinación (manipulación de comportamientos),

- gobernanza (decisiones opacas),

- ritmo (desfase temporal: máquinas vs. humanos).

La epidemiología, que depende de confianza, evidencia y acción colectiva, es especialmente vulnerable. La IE, entendida como juicio causal, es una de las últimas defensas humanas frente a sistemas que pueden amplificar patrones sin comprender sus causas.

La Inteligencia Epidemiológica como muro de contención ante la AGI (IA General)

La epidemiología analítica —con su énfasis en pensamiento crítico, inferencia causal, riesgo poblacional y ética preventiva— puede funcionar como un muro de contención ante los riesgos sociales de la AGI.

No porque pueda detenerla técnicamente, sino porque puede detectar, medir y mitigar sus efectos adversos como si fueran una epidemia social.

La epidemiología analítica siempre ha sido interdisciplinaria: nació de la estadística, la biología, la sociología, la medicina y la filosofía moral. Su rol frente a la AGI sería evaluar riesgos sistémicos a escala poblacional, tales como:

- ¿Cómo afecta la AGI la salud mental colectiva?

- ¿Qué desigualdades amplifica en acceso a servicios, información o empleo?

- ¿Cómo se propagan los efectos adversos de la AGI como una “epidemia social”?

- ¿Qué poblaciones quedan más vulnerables a manipulación algorítmica?

- ¿Qué estructuras institucionales colapsan primero bajo automatización desalineada?

¿Dónde se ubica esta función?

En el cruce entre salud pública, ciencias sociales y ética aplicada. Su rol frente a la AGI sería evaluar riesgos sistémicos a escala poblacional, tales como:

- efectos en salud mental colectiva,

- desigualdades amplificadas por automatización,

- propagación de desinformación como epidemia,

- vulnerabilidad de poblaciones específicas,

- colapso de estructuras institucionales bajo presión algorítmica.

Disciplinas que deben colaborar

- Ética aplicada y filosofía de la tecnología

- Ciencias políticas y derecho

- Psicología social y cognitiva

- Economía del comportamiento

- Ingeniería ética y seguridad de sistemas

- Sociología y antropología digital

La AGI no es un problema técnico; es un problema civilizacional.

Operación Serenidad 2025: preservar la sanidad colectiva ante la AGI

En el siglo XX, Puerto Rico enfrentó un desafío monumental: cómo modernizar su economía sin perder su alma. La respuesta fue doble:

Hoy, en pleno siglo XXI, enfrentamos un reto aún mayor: la irrupción de la inteligencia artificial general (AGI), una tecnología que puede amplificar lo mejor de la humanidad… o lo peor. Y así como Manos a la Obra necesitó a Serenidad, la revolución digital necesita una nueva Operación Serenidad.

La IE como herramienta central de esta nueva Serenidad

La epidemiología analítica —con su énfasis en causalidad, pensamiento crítico, riesgo poblacional y ética preventiva— puede convertirse en una de las instituciones intelectuales clave de esta renovación.

La AGI no amenaza solo empleos o industrias; amenaza la sanidad mental colectiva, la confianza social, la gobernanza democrática y la estabilidad de los sistemas humanos. Es decir: amenaza la salud pública en su sentido más amplio.

La IE puede actuar como un muro de contención ético y metodológico, capaz de:

- detectar efectos adversos de la AGI como si fueran una epidemia social,

- modelar desigualdades amplificadas por algoritmos,

- anticipar colapsos institucionales,

- evaluar daños a la salud mental colectiva,

- y proponer intervenciones preventivas antes de que el daño sea irreversible.

La IE no detendrá la AGI técnicamente, pero sí puede preservar la serenidad colectiva —la claridad moral, la cordura pública, la capacidad de actuar juntos—que es indispensable para navegar esta nueva era.

Así como la Serenidad original equilibró la industrialización, la Serenidad 2025 debe equilibrar la automatización cognitiva.

Manos a la Obra modernizó la economía. Serenidad protegió el alma. Hoy, la IA transforma la cognición humana misma. Por eso necesitamos una Serenidad renovada, capaz de sostener:

- la cordura,

- la ética,

- la identidad,

- la cohesión social,

- y la salud mental colectiva.

La IE es una herramienta poderosa en esta gesta porque piensa en poblaciones, no en individuos; en sistemas, no en productos; en consecuencias, no en correlaciones.

Conclusión

Estamos entrando en una era donde la IA puede amplificar lo mejor de la humanidad… o lo peor. Una era donde los algoritmos pueden influir en poblaciones más rápido de lo que la salud pública puede responder. Una era donde la epidemiología no solo estudia riesgos: se convierte en un contrapeso moral y cognitivo.

John Snow no tenía computadoras, pero tenía juicio. Ese juicio —esa capacidad de ver causas donde otros ven coincidencias—es lo que necesitamos para guiar el uso ético y responsable de la IA en salud pública. Porque si la IA se vuelve autónoma, la epidemiología será la última ciencia que piense en la población — que como bien nos recuerda el Dr. Rigau la epidemioologia significa literalmente “sobre la gente” — cuando nadie más lo haga.

Habilidades para navegar la ola de la IA

1. Fluidez causal (conceptual): Actualizar los DAGs, pensamiento contrafactual. No se necesita programar métodos, saber cuándo importan.

2. Alfabetización en IA (no Ingeniería en IA): Entender qué puede hacer la IA, qué no puede hacer y cómo supervisarla. Aprender a criticar los resultados de ML desde una perspectiva epidemiológica y ética.

3. Colaboración con Ciencia de Datos: Aportar inteligencia causal; otros aportan computación. El futuro pertenece a equipos que combinen ambos.

4. Comunicación y traducción: Fortalecer las habilidades en interpretación, encuadre narrativo y traducción de políticas. La IA produce números; los humanos producen significado.

5. Gestión responsable de Datos y Diseño: IA no puede rescatar un mal estudio.

Les exhorto a visitar mi blog sobre epidemiología para repasar el material cubierto en esta charla (versión final adjunta).

- https://cepur.info/nuestra-historia/#parte2

- https://cepur.info/nuestra-historia/#parte3

- https://cepur.info/la-salud-en-puerto-rico-siglo-xx/

- https://cepur.info/polio-en-puerto-rico-1928-1974/

- https://cepur.info/la-generacion-de-1930-en-la-ciencia-puertorriquena/

- https://cepur.info/bailey-k-ashford/

- https://cepur.info/el-colera-en-puerto-rico/

— - https://ojourbano.com.ar/john-snow-la-epidemiologia-la-geografia-el-urbanismo-y-la-inteligencia-artificial/

- https://www.galenusrevista.com/la-dra-janet-lane-claypon/

Apéndice

¿Por qué el razonamiento causal es irreducible?

El razonamiento causal en epidemiología es irreducible porque no existe ningún procedimiento algorítmico capaz de derivar la estructura causal a partir de los datos. Ningún patrón estadístico, por complejo o extenso que sea, puede resolver por sí solo la ambigüedad fundamental que separa la correlación de la causalidad. Esta imposibilidad no es técnica sino epistemológica: surge de la naturaleza misma de los sistemas causales y de los límites lógicos de la inferencia a partir de observaciones.

La primera fuente de irreducibilidad es la equivalencia estadística entre modelos causales distintos. Para un mismo conjunto de datos, pueden existir múltiples grafos causales que produzcan exactamente las mismas asociaciones observadas. Esta situación —conocida como equivalencia de Markov— implica que ningún algoritmo puede identificar la estructura causal correcta sin información adicional. Los datos, por sí solos, no contienen la respuesta. La selección entre modelos exige supuestos, y los supuestos exigen juicio.

La segunda fuente de irreducibilidad es la naturaleza contrafactual de la causalidad. Toda afirmación causal implica comparar el mundo observado con un mundo alternativo en el que la exposición o intervención hubiera sido distinta. Pero los contrafactuales no son observables ni derivables de los datos. Requieren un modelo explícito del proceso generador, una representación simbólica de cómo funciona el mundo. Esta representación no puede ser producida por un algoritmo que solo opera sobre correlaciones; requiere una decisión conceptual previa.

La tercera fuente de irreducibilidad es la complejidad combinatoria del espacio causal. A medida que aumenta el número de variables, el número de posibles estructuras causales crece de manera super‑exponencial. No existe un método computacional que pueda explorar exhaustivamente ese espacio ni comprimirlo en una regla general. La búsqueda de la estructura causal correcta no es un problema de optimización; es un problema de discernimiento.

La cuarta fuente de irreducibilidad es la dependencia del razonamiento causal en supuestos no verificables. Toda inferencia causal descansa en afirmaciones como ausencia de confusión no medida, temporalidad correcta, estabilidad de los mecanismos y validez de las intervenciones hipotéticas. Ninguno de estos supuestos puede ser probado con los datos disponibles. Todos requieren una evaluación externa al algoritmo: conocimiento del contexto, comprensión del fenómeno, experiencia acumulada y capacidad para juzgar la plausibilidad de un modelo.

Finalmente, el razonamiento causal es irreducible porque exige cambiar de marco cognitivo. El epidemiólogo debe moverse entre el modo heurístico —que detecta patrones y asociaciones— y el modo simbólico —que evalúa mecanismos, identifica supuestos y razona con contrafactuales. Este cambio de marco no está gobernado por reglas ni puede ser automatizado. Es un acto de discernimiento: la percepción de que un patrón requiere una explicación, de que una asociación exige un modelo, de que un modelo necesita un supuesto. Es un acto intuitivo en el sentido más profundo: una integración súbita de evidencia, experiencia y estructura causal.

Por estas razones, el razonamiento causal no puede ser reducido a un cálculo ni reemplazado por un algoritmo. Es un proceso que trasciende la computación porque decide qué computación es pertinente. Es irreducible porque opera en el nivel donde los datos dejan de ser suficientes y donde la mente humana debe intervenir para dar forma, sentido y dirección a la inferencia. En epidemiología, este acto constituye el núcleo mismo del juicio científico.

¿Cuál es la tesis fundamental de A New Kind of Science?

Los sistemas gobernados por reglas extremadamente simples pueden generar comportamientos de complejidad máxima, equivalentes a cualquier proceso computacional posible.

a) La complejidad no requiere leyes complejas. Patrones ricos, impredecibles y aparentemente “inteligentes” pueden surgir de reglas elementales.

b) La naturaleza puede operar como un computador universal. Muchos procesos naturales —desde fluidos turbulentos hasta sistemas biológicos— pueden tener la misma capacidad computacional que una máquina de Turing.

c) La ciencia tradicional ha ignorado un vasto espacio de comportamientos posibles. La física clásica se ha centrado en sistemas continuos, lineales o suavemente no lineales. Wolfram afirma que la verdadera diversidad de la naturaleza está en sistemas discretos, simples y computacionalmente potentes.

En resumen, la complejidad del mundo no proviene de la complejidad de las leyes, sino de la complejidad de sus consecuencias.

¿En qué consiste la “nueva ciencia”?

La “nueva ciencia” de Wolfram propone un cambio metodológico: en vez de buscar ecuaciones, debemos explorar el espacio de reglas computacionales simples.

Esto implica:

a) Usar programas simples como modelos fundamentales de la naturaleza. Especialmente autómatas celulares, sistemas de sustitución, máquinas de Turing mínimas, etc.

b) Estudiar el comportamiento generado por estas reglas mediante experimentación computacional. No deducción matemática, sino exploración sistemática.

c) Aceptar que muchos sistemas son computacionalmente irreducibles. Es decir, no existe un atajo analítico para predecir su comportamiento.

d) Reconocer que la ciencia debe incorporar la noción de “cómputo” como categoría fundamental. Así como la física incorporó el cálculo en el siglo XVII.

En palabras simples: la nueva ciencia es la ciencia de lo que hacen las reglas simples cuando se ejecutan.

Un autómata celular es un sistema dinámico discreto formado por:

- una rejilla de celdas (en una, dos o más dimensiones),

- donde cada celda puede estar en uno de varios estados finitos,

- y donde el estado de cada celda evoluciona en pasos discretos de tiempo

- siguiendo una regla local, idéntica para todas las celdas,

- que determina el nuevo estado de una celda en función de su estado actual y el de sus vecinas inmediatas.

Un autómata celular es un universo discreto donde la complejidad global surge de reglas locales extremadamente simples.

Las reglas de un autómata celular son las instrucciones locales que determinan cómo evoluciona cada celda en función de su vecindad; de su simplicidad emergen patrones de complejidad sorprendente.

El número de reglas de un autómata celular crece como , lo que significa que incluso los sistemas más simples contienen un universo casi infinito de comportamientos posibles.

Caso clásico: Autómatas celulares elementales (1D, 2 estados, vecindad de 3 celdas). Este es el sistema más estudiado por Wolfram.

- Cada celda puede estar en 2 estados (0 o 1).

- La vecindad incluye 3 celdas (izquierda, centro, derecha).

- Hay configuraciones posibles de vecindad.

- Para cada configuración, la regla debe decidir si el nuevo estado es 0 ó 1.

Por tanto:

Este es el famoso conjunto de 256 reglas elementales, donde viven la Regla 30, la Regla 110, etc.

¿Qué papel juega el azar (randomness)?

Wolfram sostiene una idea profundamente contraintuitiva: el azar aparente puede surgir de reglas completamente deterministas. Esto se observa en autómatas celulares como el famoso Regla 30 donde la regla es simple, determinista y local, pero el patrón generado es impredecible, irregular y “aleatorio”. Para Wolfram:

a) El azar no es fundamental. No es necesario postular procesos intrínsecamente aleatorios.

b) El azar es un fenómeno emergente. Surge de la complejidad generada por reglas simples.

c) La impredecibilidad se debe a la irreducibilidad computacional. Si no existe un atajo para predecir el comportamiento, entonces el sistema se comporta como si fuera aleatorio.

d) La aleatoriedad natural puede ser determinista. Esto desafía la visión tradicional de la física, que recurre al azar fundamental (como en la mecánica cuántica).

En síntesis, para Wolfram, el azar es la sombra que proyecta la irreducibilidad computacional. La estructura conceptual completa (en tres frases):

- Reglas simples → comportamientos complejos

- La mayoría de los sistemas complejos son computacionalmente irreducibles

- El azar aparente es una consecuencia de esa irreducibilidad

Contraste entre la teoría del caos y la “nueva ciencia” de Wolfram

Tanto la teoría del caos como la “nueva ciencia” de Wolfram parten de una observación común: reglas simples pueden generar comportamientos impredecibles. Pero llegan a esa conclusión desde caminos conceptuales distintos y con implicaciones diferentes.

1. Punto de partida: ecuaciones vs. reglas

Teoría del caos

- Estudia sistemas continuos, típicamente expresados como ecuaciones diferenciales no lineales.

- Ejemplos: Lorenz, Navier–Stokes, modelos poblacionales, péndulo forzado.

- El foco está en cómo pequeñas diferencias en condiciones iniciales producen trayectorias divergentes.

Wolfram / Nueva Ciencia

- Estudia sistemas discretos, especialmente autómatas celulares y programas simples.

- No parte de ecuaciones sino de reglas computacionales elementales.

- El foco está en cómo reglas extremadamente simples pueden generar complejidad máxima.

Ambos muestran complejidad emergente, pero desde lenguajes matemáticos distintos.

2. Naturaleza de la impredecibilidad

Teoría del caos. La impredecibilidad surge de:

- Sensibilidad a condiciones iniciales

- No linealidad fuerte

- Dependencia del estado completo del sistema

El sistema es determinista, pero prácticamente impredecible a largo plazo.

Wolfram. La impredecibilidad surge de:

- Irreducibilidad computacional

- Ausencia de atajos para predecir la evolución

- Equivalencia computacional entre sistemas simples y universales

El sistema es determinista, pero fundamentalmente impredecible porque no existe un método más rápido que simularlo.

Caos: impredecible por sensibilidad. Wolfram: impredecible por irreducibilidad.

3. Rol del azar (randomness)

Teoría del caos. El azar es epistemológico:

- No es que el sistema sea aleatorio,

- sino que nuestra capacidad de medir y predecir es limitada.

- El “ruido” proviene de la amplificación de incertidumbres iniciales.

Wolfram. El azar es emergente:

- Reglas deterministas pueden producir patrones indistinguibles del azar verdadero.

- La aleatoriedad aparente es una consecuencia de la irreducibilidad.

- No se necesita postular azar fundamental.

Caos: el azar surge de la sensibilidad. Wolfram: el azar surge de la complejidad computacional.

4. Qué significa “simple” en cada teoría

Caos. “Simple” significa:

- ecuaciones cortas

- pocos parámetros

- estructura matemática compacta

Pero estas ecuaciones pueden describir sistemas físicamente complejos.

Wolfram. “Simple” significa:

- reglas locales

- operaciones elementales

- programas mínimos

La complejidad surge sin ecuaciones, solo de la ejecución de reglas.

5. Implicaciones filosóficas

Teoría del caos

- La naturaleza puede ser determinista pero impredecible.

- La predicción tiene límites prácticos.

- El comportamiento complejo puede surgir de ecuaciones sencillas.

Wolfram

- La naturaleza puede ser un computador universal.

- La predicción tiene límites fundamentales, no solo prácticos.

- La complejidad es ubicua y no requiere leyes matemáticas sofisticadas.

- La ciencia debe estudiar el espacio de reglas computacionales, no solo ecuaciones.

En síntesis: la teoría del caos muestra que ecuaciones sencillas pueden producir trayectorias impredecibles; la nueva ciencia de Wolfram muestra que reglas sencillas pueden producir comportamientos computacionalmente irreducibles, indistinguibles del azar.

Contraste entre el “mundo computacional” (Wolfram) y “It from bit” (Wheeler)

1. Punto de partida: qué es lo fundamental

Wolfram: reglas computacionales. Para Wolfram, lo fundamental no es la materia ni la información, sino el proceso computacional: el universo es la ejecución de reglas simples que generan comportamientos complejos. La realidad es un proceso, no un conjunto de cosas. El ladrillo básico no es un bit, sino una regla de actualización.

Wheeler: información binaria. Para Wheeler, lo fundamental es la información: “It from bit”: todo “lo que es” proviene de respuestas binarias a preguntas fundamentales. La realidad surge de actos elementales de distinción: sí/no, 1/0. El universo es, en esencia, un procesador de información.

Wolfram: reglas → comportamiento. Wheeler: bits → realidad.

2. Ontología: qué existe realmente

Wolfram. Lo primario es la dinámica:

- reglas locales

- actualizaciones discretas

- redes de relaciones

- evolución paso a paso

La materia, el espacio y el tiempo emergen de la computación.

Wheeler. Lo primario es la información:

- bits

- decisiones binarias

- respuestas a preguntas

- actos de observación

La materia y el espacio‑tiempo emergen de la información.

Wolfram: el universo es un programa. Wheeler: el universo es un mensaje.

3. Epistemología: cómo conocemos el mundo

Wolfram. No podemos deducir el comportamiento del universo mediante ecuaciones cerradas. Debemos simular. Esto conduce a la idea de irreducibilidad computacional: no hay atajos: para saber qué hará el universo, hay que ejecutarlo.

Wheeler. El conocimiento surge de preguntas y observaciones. La física es un proceso de interrogación del universo. El bit es la unidad mínima de conocimiento.

Wolfram: conocer es simular. Wheeler: conocer es distinguir.

4. El papel del azar

Wolfram. El azar no es fundamental. Es una consecuencia de:

- reglas simples

- irreducibilidad

- complejidad emergente

El azar aparente es determinismo opaco.

Wheeler. El azar puede ser fundamental, especialmente en el contexto cuántico. Los bits pueden surgir de:

- colapsos cuánticos

- decisiones de la naturaleza

- actos de observación

El azar es parte constitutiva del “bit”.

- Wolfram: el azar es emergente.

- Wheeler: el azar puede ser originario.

5. Relación con la física

Wolfram. Propone reemplazar las ecuaciones diferenciales por programas discretos. La física es un caso particular de la computación.

Wheeler. Propone reinterpretar la física como información en acción. La física es un caso particular de la teoría de la información.

Wolfram: física = computación. Wheeler: física = información.

En síntesis:

- Wolfram imagina un universo que “se ejecuta”;

- Wheeler imagina un universo que “se responde”.

- Wolfram: reglas computacionales → complejidad.

- Wheeler: bits de información → existencia.

- Ambos ven la realidad como algo discreto y generativo, pero difieren en qué es lo primario: la regla (Wolfram) o la información (Wheeler).

Heráclito y el mundo computacional (Wolfram)

Heráclito afirma:

- Todo fluye

- Nada permanece

- La realidad es proceso, devenir, transformación

Wolfram: la realidad es un proceso computacional en ejecución

- No hay “cosas”, solo actualizaciones.

- El universo no “es”, sino que se hace a cada paso.

- La estructura surge del flujo continuo de reglas locales.

- La complejidad es dinámica, emergente, irreducible.

En otras palabras, Wolfram es un heracliteano digital. El universo es un río computacional: cada instante es una actualización, una transición, un paso del algoritmo cósmico.

Parménides y “It from bit” (Wheeler)

Parménides sostiene:

- El ser es uno, eterno, inmutable

- El cambio es apariencia

- La realidad última es estática y fundamental

Esto resuena con Wheeler: la realidad surge de unidades elementales de información (bits)

- El bit es la unidad mínima del ser.

- La estructura del universo es informacional, no dinámica.

- El cambio es derivado; lo fundamental es la distinción (sí/no).

- La ontología es estática: el bit es un ladrillo, no un proceso.

Por tanto, Wheeler es un parmenídeo informacional. El universo es un conjunto de “cosas” discretas (bits) que fundamentan todo lo demás.

| Tema | Heráclito | Parménides |

|---|---|---|

| Naturaleza de la realidad | Flujo, devenir | Ser, permanencia |

| Analogía moderna | Wolfram (computación) | Wheeler (información) |

| Unidad básica | Regla en acción | Bit elemental |

| Ontología | Procesal | Estática |

| Azar | Emergente del proceso | Posible propiedad fundamental |

| Epistemología | Conocer es simular | Conocer es distinguir |

Dos modos fundamentales de entender el mundo:

1. El mundo como proceso (Heráclito → Wolfram)

- Lo real es el cambio

- Las leyes son reglas en ejecución

- La complejidad surge del devenir

- La predicción es limitada por irreducibilidad

2. El mundo como estructura (Parménides → Wheeler)

- Lo real es la forma

- Las leyes son relaciones estáticas

- La información es el fundamento

- El cambio es derivado

Ambas visiones son necesarias, pero irreconciliables en su raíz.

Relectura metafísica: “Habiendo permeado a todo el universo con mi ser, yo permanezco”

En la Gītā, Krishna afirma que Él permea el universo entero, pero no es contenido por él. Una posible relectura plantea:

- “permeado” → procesos computacionales que fluyen, actualizan, transforman

- “yo permanezco” → la base informacional, el bit primordial, la identidad que no cambia

Es una síntesis idónea: el devenir computacional (Heráclito/Wolfram) ocurre dentro de un fundamento informacional que permanece (Parménides/Wheeler).

1. “Habiendo permeado…” → el universo como proceso computacional

Esto evoca la visión de Wolfram:

- reglas simples

- actualizaciones locales

- irreducibilidad

- complejidad emergente

- flujo constante de estados

El universo es un río computacional: cada instante es una actualización del programa cósmico. En términos heracliteanos: todo fluye porque todo se computa.

2. “…yo permanezco” → It from bit (Wheeler)

La otra mitad:

- el bit como unidad fundamental

- la distinción sí/no como acto originario

- la información como sustrato del ser

- la permanencia detrás del cambio

En términos parmenídeos: el ser es uno, estable, indivisible: el bit.

Wheeler diría: El universo surge de decisiones binarias fundamentales.

3. La síntesis: proceso y fundamento. Reinterpretación de la Gītā como una metafísica computacional: el proceso computacional permea el universo, pero el fundamento informacional permanece. Es decir:

- El cómputo es el devenir.

- El bit es el ser.

- El universo es la danza entre ambos.

Sería lo que Krishna expresa en clave espiritual:

- Él actúa en el mundo (proceso).

- Él permanece más allá del mundo (fundamento).

Así, se resuelve la tensión entre:

- Wolfram (el universo es un programa en ejecución)

- Wheeler (el universo es información)

y se reinterpreta como: el programa es la manifestación; la información es la esencia.

Heráclito (todo fluye) y Parménides (el ser permanece) se reconcilian en una estructura fractal: el flujo es la expresión del ser; el ser es la fuente del flujo.

5. La Gītā como puente entre metafísica antigua y ciencia computacional

Krishna dice:

- “Yo sostengo el universo” → Wheeler

- “Yo me manifiesto en todas las formas” → Wolfram

- “Yo permanezco inmutable” → Parménides

- “Yo actúo sin actuar” → Heráclito

Nuestra relectura no es una metáfora; sería una traducción conceptual entre tradiciones.

Habiendo permeado el universo entero mediante los procesos computacionales del devenir, yo permanezco como el fundamento informacional que no cambia.

(Bhagavad Gītā, reinterpretada en clave computacional)

Cuando Wolfram adjudica irreducibilidad computacional, ¿esta implicitamente indicando la existencia de un fundamento informacional irreducicle al cómputo?

1. ¿Qué significa adjudicar irreducibilidad computacional?

Cuando Wolfram afirma que un sistema es computacionalmente irreducible, está diciendo que no existe ningún procedimiento computacional más rápido que la propia evolución del sistema.

Es decir:

- no hay atajos,

- no hay compresión,

- no hay predicción sin simulación,

- no hay “meta‑cómputo” que domine al cómputo.

Esto coloca un límite absoluto a lo que la computación puede hacer. Y aquí aparece la clave:

Para afirmar un límite absoluto de la computación, debe existir un punto de referencia que no sea computacional.

2. ¿Qué es ese punto de referencia?

Wolfram no lo llama así, pero lo describe indirectamente:

- un espacio de posibles reglas,

- un sustrato de estados,

- una estructura de equivalencias,

- un universo de comportaciones posibles (el ruliad),

- un marco conceptual desde el cual definimos computación.

Todo eso funciona como un fundamento informacional: un dominio de posibilidades que no es generado por el cómputo, sino que lo hace posible. Es decir el cómputo ocurre dentro de ese fundamento, pero el fundamento no es reducible al cómputo mismo.

3. ¿Implica esto un “ser” informacional que permanece?

Sí, aunque Wolfram nunca lo formula en términos ontológicos. Los procesos computacionales permeen el universo, pero hay un fundamento informacional que permanece. Ese fundamento:

- no cambia con la ejecución,

- no es generado por la regla,

- no es reducible a la dinámica,

- no es un resultado del cómputo,

- sino la condición de posibilidad del cómputo.

En términos filosóficos, la irreducibilidad computacional presupone una estructura informacional irreducible.

4. ¿Por qué Wolfram no lo dice explícitamente?

Porque su proyecto es epistemológico y metodológico, no metafísico. Pero su teoría tiene consecuencias metafísicas inevitables:

- Si el universo es computación,

- y la computación tiene límites,

- entonces esos límites apuntan a algo más fundamental que el cómputo.

Ese “algo” es lo que Wheeler llamaría bit, lo que Parménides llamaría ser, y lo que la Gītā llama lo que permanece.

Por lo tanto, podríamos decir que al afirmar la irreducibilidad computacional, Wolfram está señalando —aunque sin nombrarlo— un fundamento informacional que no puede ser reducido al cómputo mismo. Ese fundamento es lo que “permanece” mientras los procesos computacionales “permean” el universo.

La irreducibilidad computacional de Wolfram conduce inevitablemente a un territorio kantiano, aunque Wolfram nunca lo formule así

1. La irreducibilidad computacional como límite de la razón.

Cuando Wolfram dice: “No existe un método más rápido que la propia evolución del sistema” está afirmando un límite estructural de la razón computacional:

- no hay atajos,

- no hay compresión,

- no hay deducción que sustituya la ejecución,

- no hay “visión desde fuera” del proceso.

Esto es exactamente lo que Kant llama el límite de la razón discursiva. La razón solo puede operar paso a paso, siguiendo reglas. Y Wolfram demuestra que hay sistemas donde ese modo de conocer no basta. Ahí aparece la sombra de la cosa en sí.

2. La “cosa en sí” como fundamento irreducible.

Para Kant:

- la razón opera mediante categorías,

- pero esas categorías no agotan la realidad,

- hay un “ser” que no puede ser captado por el entendimiento discursivo,

- solo puede ser intuido (en el sentido trascendental).

El fundamento informacional irreducible es la “cosa en sí” del universo computacional. No es computable. No es reducible. No es accesible por reglas. No es derivable de la experiencia. No es simulable. Es condición de posibilidad, no resultado.

3. La intuición como acceso al fundamento

Kant distingue dos modos de conocer:

a) Conocimiento discursivo (razón)

- secuencial

- analítico

- categorial

- computable

b) Conocimiento intuitivo

- inmediato

- sintético

- no secuencial

- no reducible a reglas

La intuición es la facultad que permite captar lo que la computación no puede reducir. En otras palabras: la razón computa, la intuición comprende; la razón analiza, la intuición integra; la razón opera en el fenómeno, la intuición roza la cosa en sí.

4. Wolfram sin saberlo está rozando a Kant,

Wolfram dice:

- “No hay atajos.”

- “No hay compresión.”

- “No hay meta‑regla que domine la regla.”

- “El sistema solo se conoce ejecutándolo.”

Kant diría: la razón no puede trascender sus propias condiciones.

Nosotros estamos infiriendo lo que Wolfram no formula: si la computación tiene límites, entonces hay un fundamento que no es computacional. Ese fundamento es informacional (Wheeler), ontológico (Parménides), trascendental (Kant) y divino (Gītā).

Por tanto, al hablar de irreducibilidad computacional, Wolfram está señalando —sin nombrarlo— un fundamento irreducible al cómputo. Ese fundamento es análogo a la “cosa en sí” kantiana: inaccesible a la razón discursiva, pero accesible a la intuición.

Reportajes:

- https://www.metro.pr/noticias/2026/04/08/puede-la-inteligencia-artificial-sustituir-al-epidemiologo-experto-lanza-advertencia/

- https://www.upr.edu/la-escuela-graduada-de-salud-publica-del-recinto-de-ciencias-medicas-presento-conferencia-sobre-epidemiologia-e-inteligencia-artificial/

- https://phlatames.com/expertos-analizan-el-impacto-de-la-inteligencia-artificial-en-la-epidemiologia-desde-el-rcm-upr/27576

- https://www.facebook.com/share/p/1CUGfXA3D4/?mibextid=wwXIfr

- https://www.facebook.com/share/p/1CSoUSygX9/?mibextid=wwXIfr

PD: Adjunto archivo pdf de una charla contrafáctica elaborada con la asistencia de IA (sin curar).